Искусственный интеллект помогает раскрывать анонимные аккаунты в социальных сетях

Содержание:

Современные системы искусственного интеллекта всё чаще используются для анализа данных в интернете. Новые исследования показывают, что крупные языковые модели могут помогать устанавливать личности пользователей, которые ранее считались анонимными в социальных сетях.

Специалисты по искусственному интеллекту Саймон Лермен и Дэниел Палека провели эксперимент, в котором проверили способность моделей находить связи между анонимными профилями и реальными людьми. По результатам тестов система смогла сопоставить значительную часть аккаунтов с профилями на других платформах. Исследователи отмечают, что такие технологии могут изменить представление о приватности в цифровом пространстве.

По данным международных аналитических отчётов, более 4,9 миллиарда человек в мире пользуются социальными сетями, а около 30–40% пользователей имеют хотя бы один псевдоним или анонимный профиль. Это означает, что огромное количество людей потенциально может быть идентифицировано по косвенным цифровым следам.

Как искусственный интеллект находит реальных людей

Во время исследования в систему вводили данные из анонимных профилей: тексты сообщений, упоминания событий, мест или привычек. После этого искусственный интеллект анализировал открытые источники в интернете и пытался найти совпадения.

Например, в гипотетическом случае пользователь упоминал проблемы в школе и прогулки с собакой по имени Бисквит в парке Долорес. Система сравнила эти детали с другими платформами и смогла с высокой точностью определить владельца аккаунта.

Крупные языковые модели способны синтезировать информацию из разных источников — от постов в социальных сетях до форумов, блогов и открытых баз данных. То, что раньше требовало многих часов ручного анализа, теперь выполняется автоматически.

Риски для приватности и кибербезопасности

Эксперты предупреждают, что такие технологии могут использоваться не только для исследований. Государства могут применять их для мониторинга активистов или анонимных пользователей, а киберпреступники — для создания сложных мошеннических схем.

Согласно отчётам по кибербезопасности, в 2023 году более 70% фишинговых атак использовали персонализированную информацию о жертве. Искусственный интеллект может значительно упростить создание таких атак, анализируя открытые данные человека.

Профессор кибербезопасности Марк Хуарес отмечает, что языковые модели способны анализировать не только социальные сети, но и другие открытые источники, включая статистические базы данных или медицинские записи, которые могут быть недостаточно анонимизированы.

Означает ли это конец анонимности

Несмотря на потенциальные риски, исследователи подчёркивают, что искусственный интеллект не всегда способен точно идентифицировать человека. Во многих случаях данных недостаточно или существует слишком много возможных совпадений.

Профессор Марти Херст объясняет, что такие системы работают только тогда, когда пользователь повторяет одинаковые детали о себе на разных платформах.

Специалисты призывают пересмотреть подходы к защите персональных данных. Среди возможных решений — ограничение массового сбора информации, контроль веб-скрапинга и уменьшение объёмов открытых данных.

Оставить комментарий

Комментарии

Комментариев пока нет. Будьте первым, кто прокомментирует!

Вам также может понравиться

Почему всё больше людей покупают готовые аккаунты вместо развития с нуля в 2026 году

20-05-2026

Рейтинг: 0 | Просмотры: 165 | Время чтения: 1 мин

Читать →

Павел Дуров представил Cocoon — приватный ИИ на блокчейне TON

07-11-2025

Рейтинг: 0 | Просмотры: 1495 | Время чтения: 1 мин

Читать →

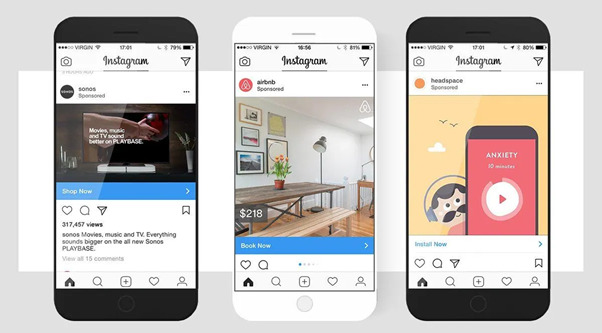

Реклама в Instagram: как работает, кому подходит и почему это больше, чем просто тренд

21-05-2025

Рейтинг: 0 | Просмотры: 1882 | Время чтения: 1 мин

Читать →

Готовится ли Telegram к выходу на рынок США?

19-05-2025

Рейтинг: 0 | Просмотры: 1851 | Время чтения: 1 мин

Читать →

Как поколения Z и Alpha меняют розничную торговлю

23-05-2025

Рейтинг: 0 | Просмотры: 1979 | Время чтения: 1 мин

Читать →